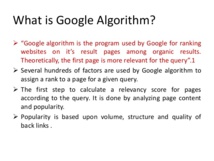

Una explicación del algoritmo de búsqueda de guguel excluyendo el pago para figurar en sus resultados

"Los algoritmos no son necesariamente equitativos, puesto que es la persona que los crea la que define su funcionamiento y sus resultados", subraya Cathy O'Neil, una científica especializada en datos informáticos y autora del libro "Weapons of Math Destruction" (Armas matemáticas de destrucción), que critica el uso generalizado y opaco de los algoritmos.

Durante un reciente foro organizado por el centro de reflexión New America, O'Neil alertó sobre la "confianza ciega" depositada en los algoritmos para obtener resultados objetivos.

El algoritmo más célebre es sin dudas aquel que permitió a Google imponerse en el sector de los motores de búsqueda y que es constantemente modificado y mejorado para brindar el resultado más aproximado a lo que requiere el internauta.

También Facebook utiliza un famoso algoritmo que analiza todos los datos de sus usuarios para ayudarlos a encontrar nuevos amigos y el contenido más adaptado a sus aspiraciones.

Pero los algoritmos también sirven para detectar un cáncer de piel y redactar artículos a partir de datos brutos.

También se usan en política. La campaña del presidente estadounidense Donald Trump se sirvió de datos de firmas de marketing que utilizan algoritmos que identifican los lugares con mayor tasa de electores susceptibles de ser convencidos por los argumentos de un candidato.

Cathy O'Neil cita varios ejemplos en los que los algoritmos tuvieron efectos nefastos.

En 2010 escuelas públicas de Washington despidieron a más de 200 profesores, algunos de ellos sumamente respetados, en función de una evaluación realizada por un algoritmo.

Algunas colectividades locales asignan sus recursos destinados a poblaciones desfavorecidas en función de criterios elaborados a partir de fórmulas matemáticas. La manera en que los datos son ingresados puede influir en el resultado.

Lo mismo sucede a la hora de determinar penas de cárcel. Datos como el barrio del que es originario el condenado o sus frecuentaciones pueden influir en la decisión del juez.

En el terreno financiero, el uso de algoritmos para otorgar créditos y asignar seguros puede desfavorecer aún más a aquellos que ya forman parte de los sectores más vulnerables.

Un informe de la Casa Blanca publicado el año pasado ya advertía que el uso de algoritmos en sustitución de la intervención humana podía llevar a perjudicar aún más a los más pobres.

Zeynep Tufekci, profesora en la Universidad de Carolina del Norte especializada en tecnologías, recuerda que las decisiones tomadas automáticamente se basan a menudo en datos recopilados sobre las personas, incluso sin que estas estén informadas al respecto.

"Estos sistemas informáticos pueden deducir cantidad de cosas de nuestras migajas informáticas aun si tomamos precauciones para no revelar nada", dijo la investigadora en una reciente conferencia TED, un organismo sin fines de lucro que organiza seminarios en todo el mundo.

"Pueden deducir preferencias sexuales, rasgos de personalidad, ideas políticas" de las personas. "Tienen un poder de previsión que puede llegar a ser extraordinariamente exacto", señaló

Según Frank Pasquale, profesor de derecho en la Universidad de Maryland, los usos no equitativos de datos pueden ser corregidos por leyes de protección de los consumidores.

La legislación vigente en la Unión Europea sobre la protección de datos y el "derecho a la explicación" de que goza una persona que dice ser víctima de una decisión tomada a partir de un algoritmo "merece ser estudiada".

Para Alethea Lange, analista del Centro para la Democracia y la Tecnología, un modelo de ese tipo "suena bien" pero "es realmente muy pesado" y difícil de implementar eficazmente por la permanente evolución de los algoritmos. La educación y el debate son más importantes que la legislación, destacó.

Daniel Castro, vicepresidente de la Fundación para la Innovación y las Tecnologías de la Información, sostiene por su lado que los algoritmos no deben ser los chivos expiatorios de los males sociales.

Decisiones automáticas adoptadas a partir de fórmulas matemáticas permiten "acciones más rápidas, más eficaces para los consumidores, las empresas y los gobiernos", defiende.

Y sostiene que los despidos por prejuicios sociales, por ejemplo, existen también "en el mundo no-algorítmico".

Durante un reciente foro organizado por el centro de reflexión New America, O'Neil alertó sobre la "confianza ciega" depositada en los algoritmos para obtener resultados objetivos.

El algoritmo más célebre es sin dudas aquel que permitió a Google imponerse en el sector de los motores de búsqueda y que es constantemente modificado y mejorado para brindar el resultado más aproximado a lo que requiere el internauta.

También Facebook utiliza un famoso algoritmo que analiza todos los datos de sus usuarios para ayudarlos a encontrar nuevos amigos y el contenido más adaptado a sus aspiraciones.

Pero los algoritmos también sirven para detectar un cáncer de piel y redactar artículos a partir de datos brutos.

También se usan en política. La campaña del presidente estadounidense Donald Trump se sirvió de datos de firmas de marketing que utilizan algoritmos que identifican los lugares con mayor tasa de electores susceptibles de ser convencidos por los argumentos de un candidato.

- Consecuencias nefastas -

Cathy O'Neil cita varios ejemplos en los que los algoritmos tuvieron efectos nefastos.

En 2010 escuelas públicas de Washington despidieron a más de 200 profesores, algunos de ellos sumamente respetados, en función de una evaluación realizada por un algoritmo.

Algunas colectividades locales asignan sus recursos destinados a poblaciones desfavorecidas en función de criterios elaborados a partir de fórmulas matemáticas. La manera en que los datos son ingresados puede influir en el resultado.

Lo mismo sucede a la hora de determinar penas de cárcel. Datos como el barrio del que es originario el condenado o sus frecuentaciones pueden influir en la decisión del juez.

En el terreno financiero, el uso de algoritmos para otorgar créditos y asignar seguros puede desfavorecer aún más a aquellos que ya forman parte de los sectores más vulnerables.

Un informe de la Casa Blanca publicado el año pasado ya advertía que el uso de algoritmos en sustitución de la intervención humana podía llevar a perjudicar aún más a los más pobres.

- Migajas informáticas -

Zeynep Tufekci, profesora en la Universidad de Carolina del Norte especializada en tecnologías, recuerda que las decisiones tomadas automáticamente se basan a menudo en datos recopilados sobre las personas, incluso sin que estas estén informadas al respecto.

"Estos sistemas informáticos pueden deducir cantidad de cosas de nuestras migajas informáticas aun si tomamos precauciones para no revelar nada", dijo la investigadora en una reciente conferencia TED, un organismo sin fines de lucro que organiza seminarios en todo el mundo.

"Pueden deducir preferencias sexuales, rasgos de personalidad, ideas políticas" de las personas. "Tienen un poder de previsión que puede llegar a ser extraordinariamente exacto", señaló

Según Frank Pasquale, profesor de derecho en la Universidad de Maryland, los usos no equitativos de datos pueden ser corregidos por leyes de protección de los consumidores.

La legislación vigente en la Unión Europea sobre la protección de datos y el "derecho a la explicación" de que goza una persona que dice ser víctima de una decisión tomada a partir de un algoritmo "merece ser estudiada".

Para Alethea Lange, analista del Centro para la Democracia y la Tecnología, un modelo de ese tipo "suena bien" pero "es realmente muy pesado" y difícil de implementar eficazmente por la permanente evolución de los algoritmos. La educación y el debate son más importantes que la legislación, destacó.

Daniel Castro, vicepresidente de la Fundación para la Innovación y las Tecnologías de la Información, sostiene por su lado que los algoritmos no deben ser los chivos expiatorios de los males sociales.

Decisiones automáticas adoptadas a partir de fórmulas matemáticas permiten "acciones más rápidas, más eficaces para los consumidores, las empresas y los gobiernos", defiende.

Y sostiene que los despidos por prejuicios sociales, por ejemplo, existen también "en el mundo no-algorítmico".

Inicio

Inicio Política

Política